AI, Moral dan Perang Digital Media Sosial: Bagaimana Algoritma Membentuk Kebenaran Konflik Timur Tengah

Ketika ini, medan perang digital turut sama sengit seperti di medan perang sebenar. Untuk memahami bagaimana konflik yang terjadi ketika ini antara Iran dan paksi Amerika Syarikat–Israel dipersembahkan di ruang digital terutamanya di media sosial, kita perlu melihat dua konsep utama iaitu Responsible AI (Kecerdasan Buatan yang Bertanggungjawab) dan Moral Framing Theory (Teori Pembingkaian Moral). Kedua-dua konsep ini memainkan peranan penting dalam menentukan bagaimana maklumat disampaikan dan bagaimana pengguna menafsirkannya. Responsible AI merujuk kepada pembangunan dan penggunaan AI secara beretika. Ia berasaskan lima prinsip utama iaitu keadilan (fairness), kebolehjelasan (explainability), privasi dan keselamatan, akauntabiliti, serta ketelusan (transparency). Prinsip-prinsip ini bertujuan memastikan sistem AI tidak berat sebelah dan boleh dipercayai. Moral Framing Theory pula menerangkan bagaimana manusia memahami dunia melalui nilai moral tertentu. Antara konstruk utama ialah Care/Harm (penjagaan vs. penderitaan), Fairness/Cheating (keadilan vs. penipuan), Loyalty/Betrayal (kesetiaan vs. pengkhianatan), Authority/Subversion (kepatuhan vs. pemberontakan), dan Sanctity/Degradation (kesucian vs. pencemaran). Apabila AI menggunakan struktur ini dalam algoritma media sosial, ia bukan sekadar menyampaikan maklumat tetapi turut membentuk cara kita menilai siapa yang betul dan siapa yang salah.

Dalam dunia hari ini, AI memainkan peranan besar dalam menentukan naratif konflik geopolitik. Platform seperti Facebook, TikTok, Instagram, Threads, Truth Social dan X menggunakan algoritma yang memilih kandungan berdasarkan kebarangkalian untuk menarik perhatian pengguna. Kandungan yang beremosi tinggi atau kontroversi biasanya lebih diutamakan kerana ia meningkatkan interaksi (engagement). Akibatnya, pengguna sering terdedah kepada naratif yang kuat dari segi emosi namun tidak semestinya seimbang atau tepat.

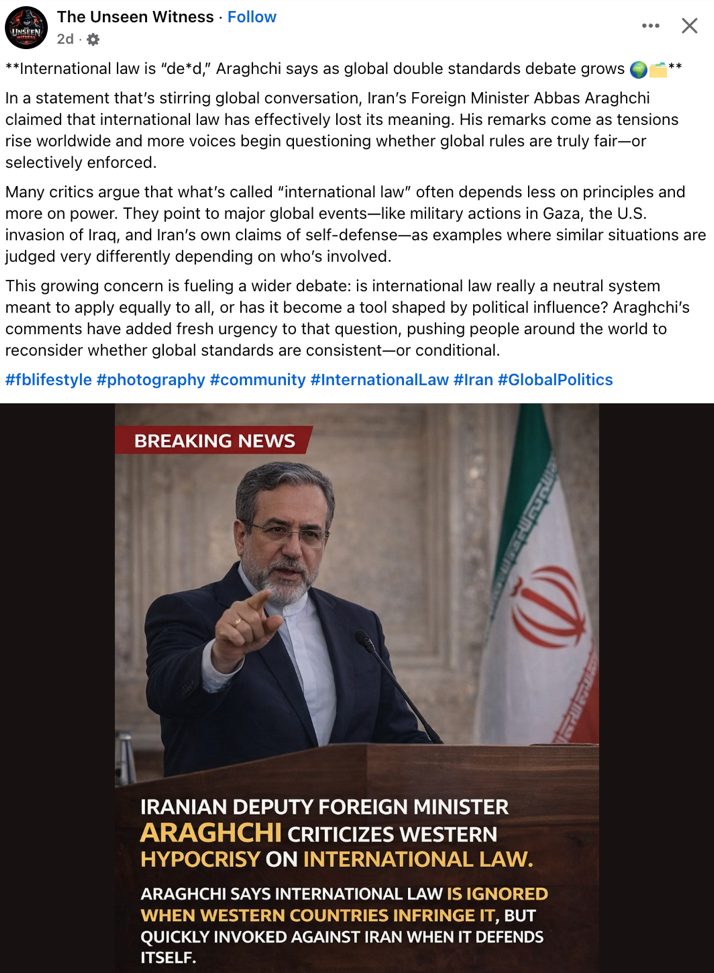

Bagi pihak yang dilihat sebagai tertindas (contoh terkini seperti Iran dan Palestine), dalam sesetengah naratif, kandungan sering dibingkaikan menggunakan elemen Care/Harm dan Fairness/Cheating. Kisah penderitaan, ketidakadilan, dan mangsa konflik menjadi tumpuan. Dalam situasi ini, prinsip keadilan dalam Responsible AI amat penting. Tanpanya, kandungan yang membawa suara kemanusiaan boleh ditapis atau disekat atas alasan “sensitif”, manakala naratif pihak lawan mungkin terus disebarkan tanpa sekatan. Ini menimbulkan persoalan besar tentang akauntabiliti platform digital.

Rajah 1: Bingkai Moral dari Sudut Pandang Paksi Iran

Sumber: https://www.facebook.com/share/p/1AyjnQuGnn/

Isu menjadi lebih rumit apabila kita melihat kepada sumber maklumat yang dianggap paling objektif seperti data fizikal seperti imej satelit. Tindakan syarikat seperti Planet Labs yang menghadkan akses awam kepada imej satelit beresolusi tinggi di kawasan konflik memberi kesan besar terhadap ketelusan maklumat. Imej satelit sering digunakan oleh wartawan dan penyelidik untuk mengesahkan kejadian sebenar. Apabila akses ini disekat, masyarakat awam kehilangan “bukti visual” yang boleh dipercayai. Tanpa data ini, pengguna media sosial bergantung kepada video pendek atau teks yang sukar disahkan. Ini membuka ruang kepada penyebaran maklumat yang berat sebelah atau tidak tepat. Keadaan ini mewujudkan jurang maklumat, di mana hanya pihak tertentu mempunyai akses kepada kebenaran penuh, manakala orang awam terpaksa membuat kesimpulan berdasarkan maklumat yang terhad. Ketiadaan bukti visual seperti imej kemusnahan juga menguatkan lagi naratif ini. Tanpa gambar hospital atau kawasan awam yang terjejas, pengguna mungkin lebih mudah menerima justifikasi tindakan ketenteraan. Ini menunjukkan kegagalan Responsible AI dalam memastikan kepelbagaian maklumat dan keseimbangan naratif.

Rajah 2: Sekatan imej satelit oleh syarikat berkepentingan

Sumber: FMT, https://www.facebook.com/share/p/1H64F18nat/

Bagi Amerika Syarikat dan Israel, naratif yang digunakan sering berasaskan Authority/Subversion dan Loyalty/Betrayal. Tindakan ketenteraan dibingkaikan sebagai usaha mempertahankan keamanan atau menentang ancaman “pengganas”. Dalam konteks ini, algoritma media sosial boleh mengukuhkan “filter bubble” atau gelembung penapis. Pengguna hanya melihat kandungan yang menyokong pandangan sedia ada mereka, tanpa terdedah kepada perspektif lain.

Rajah 3: Bingkai Moral dari Sudut Pandang Paksi AS-Israel

Sumber: https://www.facebook.com/share/p/1GVhKBghAp/

Sementara itu, negara-negara neutral atau pihak yang mengambil pendekatan diplomatik menghadapi cabaran tersendiri. Mereka sering menekankan nilai Sanctity/Degradation, terutamanya apabila melibatkan pelanggaran norma kemanusiaan. Namun, apa yang menyedihkan adalah naratif yang bersifat sederhana dan rasional ini sering tenggelam dalam lautan kandungan yang lebih sensasi.

Algoritma media sosial cenderung mengutamakan kandungan yang mencetuskan kemarahan moral (moral outrage). Ini kerana emosi yang kuat mendorong pengguna untuk berkongsi dan memberi reaksi. Tanpa mekanisme pencegahan yang berkesan, perbincangan digital boleh bertukar menjadi ucapan kebencian atau konflik sebenar di dunia fizikal. Di sinilah pentingnya pengawasan manusia (human oversight) dalam sistem AI. Walaupun AI mampu memproses data dalam jumlah besar, ia masih tidak memahami konteks budaya dan politik secara mendalam. Tanpa campur tangan manusia (human-in-the-loop), sistem AI mungkin membuat keputusan yang tidak adil atau tidak sensitif terhadap situasi sebenar. Masalah utama hari ini ialah ketelusan. Pengguna tidak tahu mengapa sesuatu kandungan muncul dalam paparan “For Your Page, FYP” mereka. Adakah ia dipilih kerana nilai maklumatnya, atau kerana potensinya untuk menimbulkan emosi? Kekaburan ini mewujudkan jurang akauntabiliti yang besar, terutama apabila keputusan dibuat oleh syarikat teknologi yang dipengaruhi oleh kepentingan tertentu.

Kesimpulannya, perbincangan tentang konflik Iran–AS–Israel di media sosial bukan sekadar soal fakta, tetapi soal bagaimana fakta itu dibingkaikan. AI memainkan peranan penting dalam menentukan naratif yang kita lihat dan emosi yang kita rasai. Responsible AI sepatutnya menjadi pelindung yang memastikan maklumat disampaikan secara adil dan telus. Namun, tanpa data yang terbuka dan sistem yang bertanggungjawab, AI boleh menjadi alat yang menguatkan bias dan polarisasi. Akhirnya, cara kita memahami konflik moden banyak bergantung kepada teknologi yang kita cipta. Persoalannya bukan lagi sama ada AI digunakan, tetapi sama ada ia digunakan dengan adil. Jika tidak, kebenaran mungkin terus tenggelam dalam algoritma yang lebih mengutamakan perhatian (engagement) berbanding keadilan.

Kata kunci: AI, Bingkai Moral, Algorithma, Perang Digital

Oleh,

Dr. Mohamad Taha Ijab

Felo Penyelidik, Institut Informatik Visual

Universiti Kebangsaan Malaysia

taha@ukm.edu.my